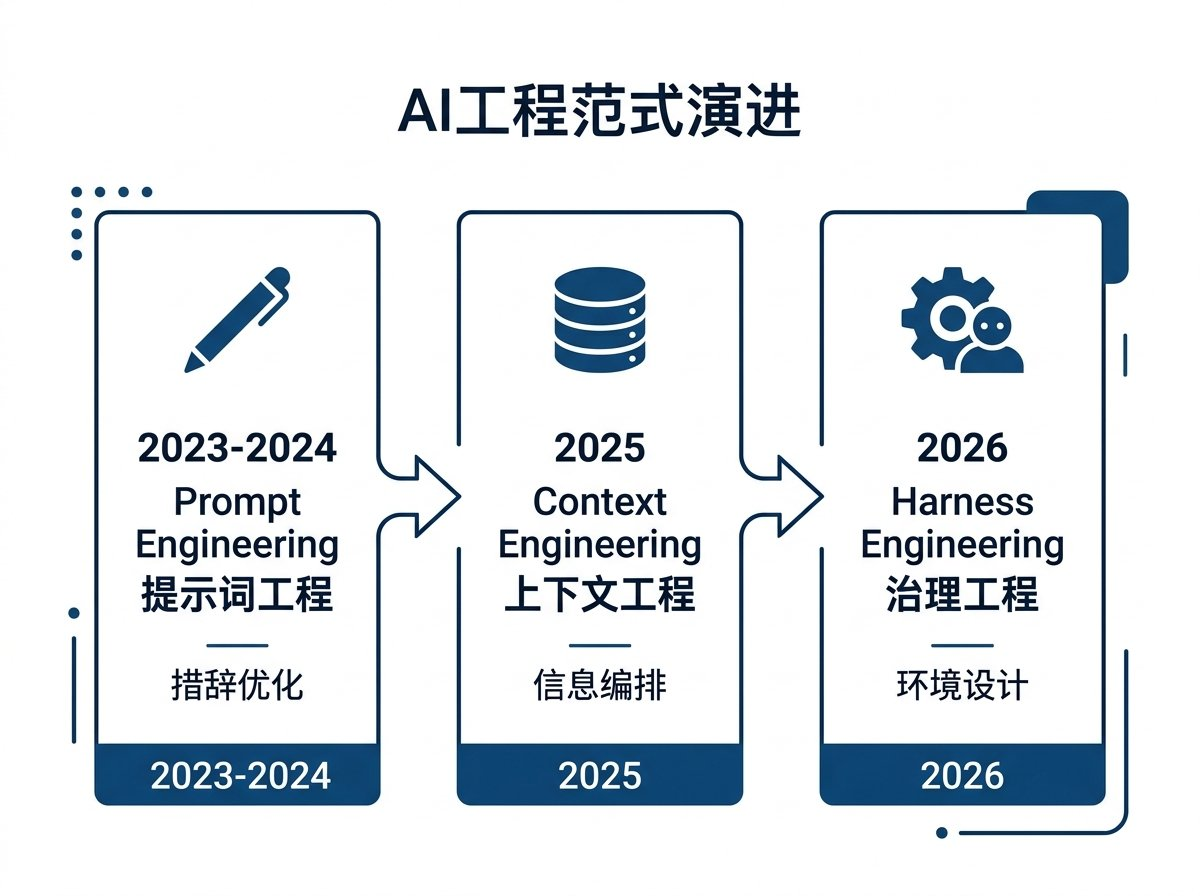

2026 年初,Anthropic 和 OpenAI 几乎同一周各自发布了一篇实践文章,讲述他们如何让 AI 把复杂任务真正做完。结合两篇学术论文和社区讨论,一个完整的图景浮现出来:过去三年,AI 工程师解决问题的方式,已经彻底换了三代。

第一代:教模型”好好说话”(2023–2024)

最早大家发现,和 AI 说话是有技巧的。同一个问题,换个问法,答案质量差距巨大。

于是工程师们开始研究怎么”提问”:措辞怎么选、要不要给几个例子、要不要让模型一步步推理……这就是所谓的 Prompt Engineering(提示词工程)。核心问题只有一个:怎么把话说清楚,让模型给出更好的回答。

这就像你新雇了一个员工,最重要的事是”怎么跟他沟通”。

第二代:把模型的”视野”管起来(2025)

光靠措辞不够了。AI 需要”看到”更多信息才能完成任务——你想让它帮你写分析报告,它得先能看到相关资料;你想让它接入工具,它得知道能用什么。

这一年,Context Engineering(上下文工程) 成了热词。Shopify 的 CEO Tobi 那句”上下文工程是新技能”广为流传。

工程师们开始把 AI 每次”看到”的内容当成系统来设计:从哪里检索资料、对话历史保留多少、可以用哪些工具……核心问题升级成:如何管理模型在一次任务里能看到的全部信息。

如果说第一代是”教他说话”,第二代就是”给他准备好资料”。

第三代:给模型搭一个”可以独立运转的环境”(2026)

现在问题变了。AI 已经可以自主工作好几个小时,甚至好几天。

一次性把话说清楚不够用,帮它备好资料也不够用——你需要的是一整套可以让它长时间稳定运转的基础设施。Anthropic 和 OpenAI 给这套东西取了同一个名字:Harness Engineering(脚手架工程)。

这一代解决的核心问题是:如何设计 AI 的整个”运行环境”,包括多个 AI 互相协作、自动检查对错、遵守规则不越界,以及记住过去学到的东西。

如果第一代是”教他说话”,第二代是”给他备料”,第三代就是”给他建一家公司”。

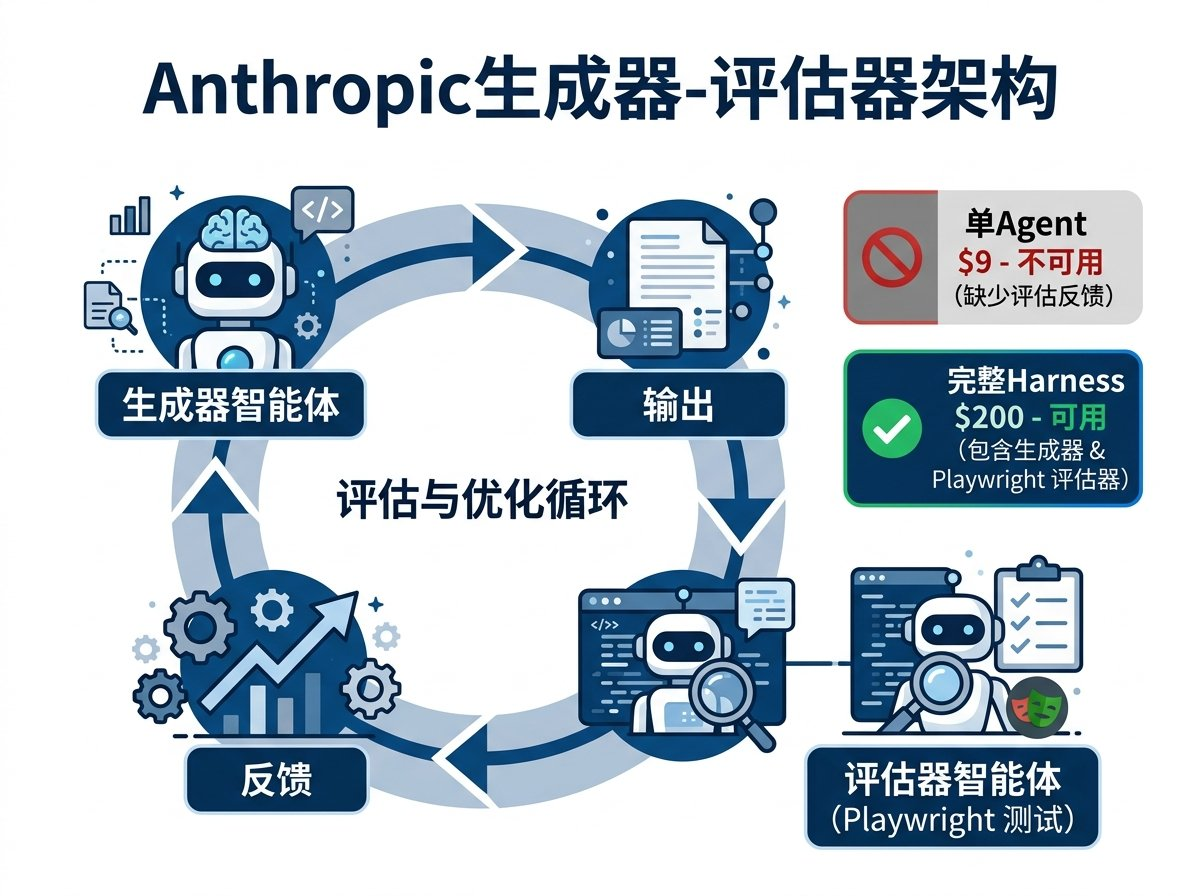

Anthropic 的做法:让 AI 互相”挑毛病”

Anthropic 工程师的实验揭示了一个反直觉的发现:让 AI 检查自己的工作,基本没用。

无论做得好不好,AI 给自己打的分永远是高分。

解决方法是把”做事”和”检查”拆成两个独立的 AI:一个负责生成,一个负责评估。而且评估不是口头打分,而是真实操作——点击页面按钮、填表单、验证功能是否正常,然后从设计质量、原创性、细节打磨、功能完整度四个维度给出评分。

结果非常直观:

| 方式 | 时间 | 花费 | 结果 |

|---|---|---|---|

| 单个 AI 自己做 | 20 分钟 | 9 美元 | 基本不能用 |

| 生成 + 评估 AI 协作 | 6 小时 | 200 美元 | 完整游戏,含动画和 AI 集成 |

这套”生成-评估”循环迭代了 5 到 15 轮。第十轮时,AI 甚至自己设计出了一个 3 D 空间导航方案。

更关键的发现是:随着模型变强,有些”脚手架”可以拆掉,但“评估器”永远不能拆。AI 自己对自己的盲点会一直存在。

OpenAI 的做法:百万行代码,工程师一行没写

OpenAI 的实验更激进:用了五个月,一个小团队借助 AI 构建了将近百万行代码的生产级系统。工程师没有手写过一行业务代码。

但这里有个关键细节:不是把任务扔给 AI 就完事了。工程师其实在做三件事:

- 设计开发环境——搭好让 AI 工作的”舞台”

- 用结构化的方式表达目标——告诉 AI 要做什么

- 给 AI 持续反馈——让它知道对不对

最核心的一点是架构治理:整个代码库被严格分成六层,每层之间的边界不是靠约定俗成,而是直接写成规则,由代码自动执行。AI 如果提交了违反架构的代码,系统会自动拒绝,不需要人来盯着。

这就是让百万行代码”不失控”的秘密:不是靠 AI 自律,而是靠规则机械化执行。

被忽视的第三块:记忆

Anthropic 讲了评估闭环,OpenAI 讲了架构约束,但两家都没深入讨论一件事:记忆。

两篇学术论文填补了这个空白。

第一篇提出了一套多个 AI 共享知识库的方案,核心问题是:当一个 AI 写入了错误信息(比如因为”幻觉”),怎么防止它污染整个知识库?

答案是引入”声誉机制”——每个 AI 都有一个信用评分,取决于它过去答对了多少、领域是否匹配等。新的知识需要多个 AI 投票认可才能写入。

效果:有这套记忆系统的 AI,准确率是没有记忆的 AI 的两倍。

第二篇回答了一个更根本的问题:有记忆的 AI 真的会随时间越来越好吗?

实验设计很有意思:

- 有记忆组:3 行提示词 + 记忆系统,每轮可以查之前积累的所有知识

- 无记忆组:50 到 200 行专家精心编写的提示词,但每轮从零开始

跑 10 轮之后,有记忆的那组,任务难度从 0.8 增长到 3.0(统计上显著增长);无记忆的那组,完全没有变化。

而两组的当前性能水平其实差不多——3 行提示词加记忆,和 200 行专家提示词打了个平手。

这说明什么?记忆系统给 AI 带来的不是更高的起点,而是持续学习的能力。

人类公司越做越有经验,是因为有文档、有复盘、有知识沉淀。现在 AI 系统也开始出现同样的特征了。

三代总结

用最简单的话说:

- Prompt Engineering:优化你怎么跟模型说话

- Context Engineering:优化模型能看到什么信息

- Harness Engineering:优化模型在什么环境里运转

Harness = 评估机制(让 AI 互相纠错)+ 架构约束(规则机械化执行)+ 记忆治理(让系统越跑越好)

少了任何一块,AI 系统都会在某个地方失控。

参考资料

- Anthropic Engineering Blog

- OpenAI Blog

- (S)AGE Paper

- Longitudinal Learning Paper